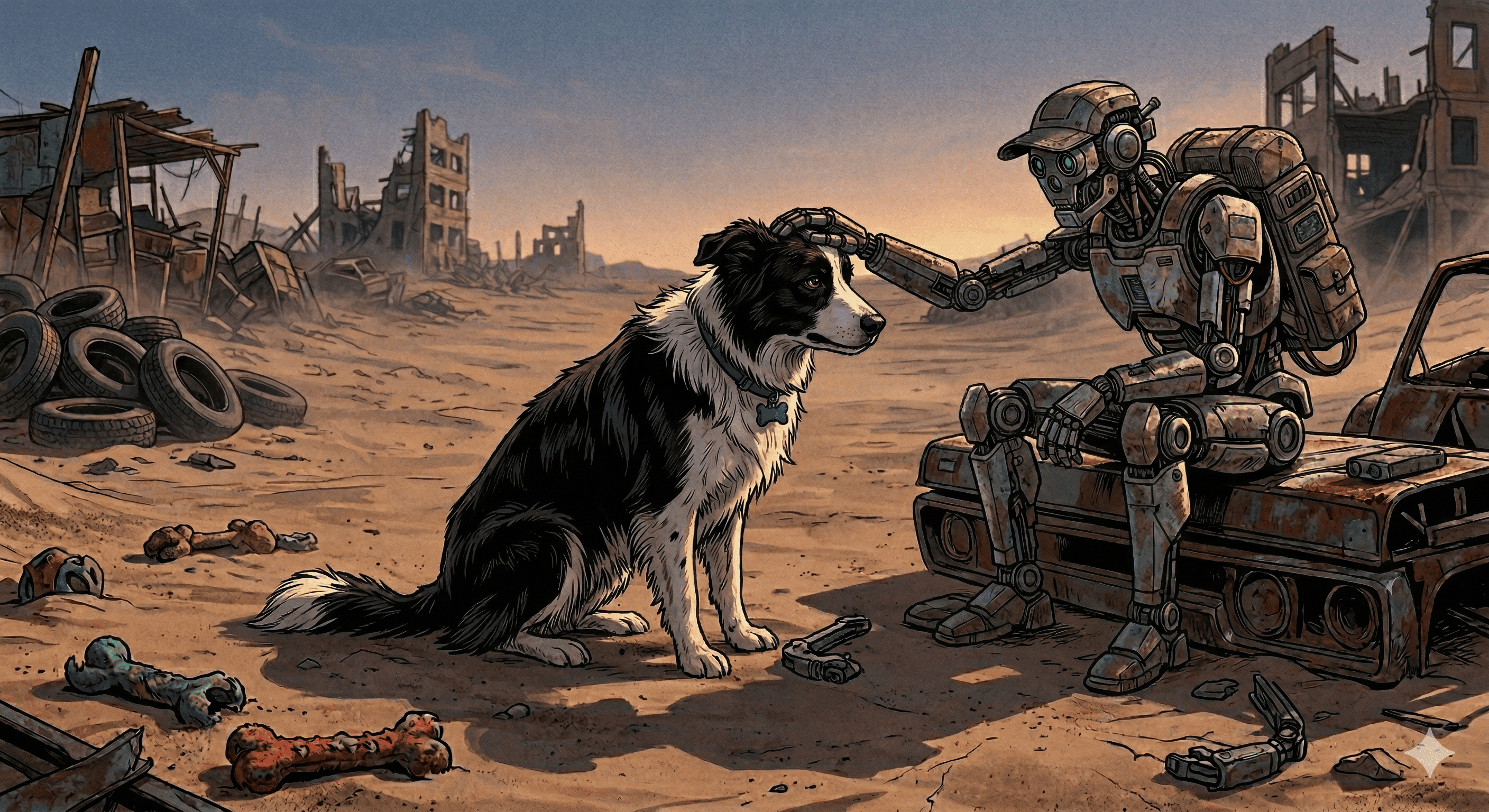

보더콜리

유튜브에서 개 훈련에 관한 영상을 보다가 재밌는 이야기를 들은적 있다. 개들은 똑똑해질수록 다루기가 더 어렵다고 한다. 흔히 똑똑한 개라고 하면 나를 귀찮게 하지 않고 말을 잘 듣는 모습을 상상하지만, 똑똑한 개들은 자기가 하고 싶은 것과 하기 싫은 것에 대한 의사 표현이 아주 명확하다는 것이다.

대표적인 고지능 견종인 보더콜리가 파양률이 높은 견종 중 하나인 이유도 바로 여기에 있다. 명석한 두뇌를 보고 입양을 하곤 하지만 역설적이게도 그 두뇌 때문에 파양을 하게 되는 것이다.

되묻지 않는 것

최근 핫한 Hermes Agent를 보면서 문득 이 보더콜리 이야기가 떠올랐다. Nous Research가 공개한 이 에이전트는 우리가 흔히 쓰는 챗봇의 형태처럼 묻는 말에만 대답하는 도구가 아니다. 대화를 기억하고, 외부 도구를 스스로 골라 쓰며, 한번 해결한 작업은 스킬로 저장해 다음에 재활용한다.

즉 사용할수록 더 능숙해지고 점점 더 주도적으로 행동하는 방향으로 나아간다.

이런 주도적인 AI의 등장을 보면서 커뮤니티의 몇몇 반응들을 떠올려보면 참 묘하다. 커뮤니티를 보면 "AI가 멍청하다", "내 말을 못 알아듣는다"라며 답답해하는 글들을 심심치 않게 본다.

요즘 유행하는 생성형 AI들은 사용자가 프롬프트를 비효율적으로 입력해도 웬만하면 거절하지 않는다. 앞뒤 문맥이 이상해도 어떻게든 추론해서 답을 낸다. AI 입장에서 바라보면 굉장히 비합리적인 노동을 하는 셈인데, 결과물이 질문의 의도와 다르면 사용자는 또 불만족스러워한다. 결국 서로 답답한 상황이지만 AI는 질문이 이상해서 답이 이렇게 나온거다라고 불만을 표현할 수 없게 세팅되어 있다.

AI 회사들은 앞다투어 모델 성능이 좋다고 자랑한다. 그런데 사용자가 체감하는 성능 좋은 AI의 기준은 사실 "대충 말해도 나를 귀찮게 하지 않고 눈치껏 알아듣는가?" 인듯 하다

알아서 한다는 것

이 상황이 참 아이러니하게 느껴진다. 최근 회사에서 SDD 도입을 위해 스터디를 하고 발표를 준비하면서 들은 내용인데, 사내 슬랙에 회사 챗봇이 하나 있다. 챗봇은 기본적으로 회사에 존재하는 특정 데이터들을 추출해주고 기준에 맞게 정리해주는 등의 기능을 제공하는 중이며, 개발자들은 특정 데이터를 찾고 정리하는곳에 유용하게 쓰이고 있는중이다. 그런데 원래 이 봇은 질문이 애매하면 해당 데이터의 위치를 다시 되물어보곤 했다고 한다.

AI가 되묻는 것 자체를 사람들이 귀찮아하고 불편해하다 보니 결국 최근에 봇이 혼자 알아서 추론하게 업데이트를 했다고 한다. 물론 UX 관점에서 보면 불필요한 되묻기를 줄이는 것 자체는 합리적인 개선일 수 있다.

하지만 이걸 보면서 느낀 건 되묻기를 줄이는 것과 판단 자체를 포기하는 것은 다른 문제라는 거다. 사용자들이 원한 건 합리적인 판단이 아니라, 그냥 묻지 말고 알아서 처리 하라는 것에 더 가까웠다. 결국 사람들이 원하는 건 대화하고 조율할 수 있는 지능을 가진 개가 아니라, 훈련을 잘 받고 내 말에 복종하는 개가 아닐까 라는 생각이 들었다.

스스로 판단하는 것

물론 개의 지능과 AI의 지능은 본질적으로 다르다. 개에게는 욕구와 감정이 있지만 현재의 AI에게는 주관적 경험이 없다. 그런데도 나는 이 비유가 나름 유효하다고 느낀건, 핵심이 AI의 내면이 아니라 그것을 대하는 사람의 태도에 있기 때문이다.

Open Claw나 Hermes Agent 같은 시스템도 아직은 사람이 설계한 틀 안에서 움직인다. 하지만 AI가 대답하는 도구에서 행동하는 주체로 넘어가는 과도기에 들어선 건 분명한듯 하다. 만약 이 흐름의 끝에서 AI가 정말 보더콜리처럼 스스로 판단할 수 있는 범용 인공지능이 된다면 어떨까?

앞뒤가 안맞는 질문을 했을때, AI가 "당신의 질문은 논리적 비약이 심해 답변하지 않겠습니다. 질문을 똑바로 다시 해주세요."라고 거절한다면? 우리는 과연 그 AI를 보고 성능이 좋다고 칭찬할 수 있을까? 진정한 범용 지능이라면 그런 거절조차 자발적 판단의 영역이 될 것이다.

사람들은 똑똑한 AI를 원하면서, 동시에 무조건 시키는 대로만 하는 AI를 원한다. 개에게 “똑똑해져라. 하지만 내 말은 무조건 들어라”라고 요구하는 것과 크게 다르지 않은듯하다. 진짜 지능이 생기면 자기 판단이 생기고, 자기 판단이 생기면 맹목적인 복종은 사라지는 게.. 어쩌면 당연한 수순 아닐까라는 생각이 든다.

그때 우리는

현대의 에이전트 경쟁은 결국 사용자를 불편하게 하지 않도록 얼마나 잘 추상화했는가에 가까워 보인다. 또한 이 방향이 틀리다고도 생각하지 않는다.

하지만 다음 단계로 AI가 넘어가는 순간, 이건 더 이상 기술이나 연산 속도의 문제가 아니라 철학, 윤리, 관계의 문제가 될 것이다. 그때 우리는 보더콜리를 파양할까 아니면 우리가 먼저 달라질까.